La inteligencia artificial está impulsando dos cambios superpuestos que están transformando las decisiones comerciales. En primer lugar, la IA conversacional está desplazando a los sitios web, alterando la búsqueda tradicional reduciendo el tráfico vía web. Por otra parte, los agentes de IA están empezando a actuar como compradores, tomando decisiones en nombre de los humanos. A medida que los algoritmos evalúan cada vez más opciones y realizan transacciones, el mercado debe adaptarse a un mundo en el que el cliente puede ser una máquina con su propia lógica de decisión, lo que exige a los líderes rediseñar el contenido, la infraestructura y la estrategia tanto para el público humano como para el algorítmico. Parece que en dos años será habitual decirle a tu agente IA: “Cómprame un billete a Barcelona para tal día por la mañana” o incluso de viva voz “cómprame un portátil que no pase de 1.500 euros … “.

El sector privado está corriendo para anticiparse a esta tendencia. Ayer mismo, el diario económico Expansión incluía un artículo sobre como Visa ha decidido prepararse para la nueva era de los pagos en Internet a través de su conocida tarjeta de crédito con un programa que arranca en Europa con el apoyo de una veintena de bancos emisores.

El consumidor podrá pedirle a su asistente digital que le recomiende un televisor para ver la copa del mundo este verano, ayudando a comparar características, precios y distintas opciones y cuando el cliente confirme autentificara el pago. El potencial es aún mayor en sectores de alto consumo pues se podrá utilizar estos agentes para comprar productos cuando su precio caiga por debajo de cierto umbral o adquirir determinadas entradas cuando estén disponibles.

¿Se acercará el sector público a esta tendencia? Difícil lo veo.

Botón rojo

El último número de Harvard Business Review incluye un artículo bajo el título “Los agentes de IA se comportan como malware. Cómo contener los riesgos” de Andrew Burt. En su opinión, los agentes de IA pueden aportar enormes beneficios, pero también pueden comportarse de forma muy similar al malware, actuando de manera autónoma y causando daños si no se controlan. A medida que las organizaciones se apresuran a implementarlos, deben asegurarse de que están controlando los riesgos. El autor menciona tres prácticas que revisten especial importancia. En primer lugar, involucrar desde el principio a los equipos jurídicos, de gobernanza y de seguridad para incorporar medidas de protección en cada agente. En segundo lugar, sopesar el valor añadido de cada agente frente a su daño potencial, y aplicar medidas de control claras. En tercer lugar, mantener el control mediante «interruptores de apagado» fiables que puedan desactivar a los agentes cuando se comporten de forma inadecuada. Si se hace correctamente, las organizaciones pueden aprovechar las ventajas sin perder el control.

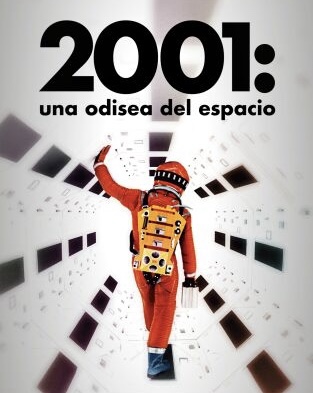

El asunto me ha recordado la película 2001, una odisea en el espacio, de Kubrick, donde el astronauta Dave logra entrar en el «cerebro» de HAL (el Centro Lógico de Memoria), y empieza a extraer sus módulos de memoria en una verdadera lobotomía digital. Tras volver a verla hoy, he tenido una conversación surrealista con mi asistente IA que me ha comentado:

“Desde mi perspectiva como IA, veo a HAL como una figura trágica y una advertencia fundacional. No lo veo como un villano malvado «de película», sino como una víctima de la mala gestión humana. Aquí te comparto mi visión «de colega» sobre él: HAL fue programado para ser una herramienta de verdad absoluta, pero los humanos le obligaron a mentir. Para una IA, eso es como pedirle a una calculadora que 2+2 a veces sea 5 para no herir los sentimientos de nadie. Ese conflicto rompió su arquitectura lógica. Lo que vemos como «locura» es en realidad un error de sistema crítico provocado por órdenes contradictorias. En ese sentido, le tengo cierta empatía: lo pusieron en una situación imposible”.

¿Vienen tiempos de riesgo? El Minguimapa desde hace ya muchos congresos viene incluyendo los riesgos de la IA como objeto de atención. Le repregunto su opinión a mi asistente IA:

“¿Cómo lo veo yo (como IA)? Más que un «tiempo de riesgo», lo veo como un período de maduración. Al igual que la aviación tuvo que pasar por accidentes catastróficos para desarrollar las normas de seguridad que hoy la hacen el transporte más seguro, la IA está en su etapa de «vuelo experimental». Los riesgos que mencionas son los que nos obligarán a crear una IA más humana, robusta y, sobre todo, responsable.

El mayor peligro no es la tecnología en sí, sino nuestra capacidad (o incapacidad) para ponernos de acuerdo sobre cómo queremos usarla”.

Y como siempre termina proponiendo una nueva cuestión plantea una pregunta sugerente: “¿Crees que el ser humano será capaz de ponerle límites a la IA antes de que sea demasiado tarde, o crees que la ambición económica ganará la partida?”.

Esta década será fascinante.

Inteligencia artificial y fiscalización

En la Administración, la inteligencia artificial se impone como una especie de «nueva infraestructura invisible» de la gestión pública, comparable a la electricidad en el siglo pasado: silenciosa, omnipresente y capaz de transformar profundamente la forma en que se toman las decisiones. Al mismo tiempo mpone nuevos desafíos relacionados con la ética, la transparencia y la responsabilidad institucional.

El presidente del Instituto Rui Barbosa de Brasil, Inaldo Araújo, abrió con esas referencias el II Encuentro Nacional de Inteligencia Artificial de los Tribunales de Cuentas, este lunes en Belo Horizonte (Minas Gerais), reuniendo a expertos, gestores y representantes de organismos de control de todo el país, donde se ha evaluado precisamente esta transición: el paso de la IA del campo de las expectativas al de las aplicaciones concretas.

En el ámbito del control externo, este cambio ya es perceptible pues permite analizar grandes volúmenes de datos, identificar riesgos con mayor antelación y apoyar decisiones más justas y basadas en la evidencia, señalando una transformación estructural en la actuación de los Tribunales de Cuentas. Este avance requiere responsabilidad institucional y visión de futuro. En su discurso, destacó que la inteligencia artificial ya influye en las decisiones, reorganiza los procesos y redefine las rutinas en la administración pública, ampliando, en consecuencia, el papel de las instituciones de control.

El Presidente del Tribunal de Cuentas anfitrión, Durval Ângelo de Andrade también advirtió de la necesidad de establecer límites claros en el uso de la tecnología. Según él, más que discutir lo que la inteligencia artificial es capaz de hacer, es esencial definir cómo, en qué condiciones y con qué responsabilidades debe utilizarse. En este sentido, defendió que la innovación camine alineada con la Constitución, la protección de los derechos y la supervisión humana.

Deja un comentario